引言

GH4169 合金是中國(guó)航空發(fā)動(dòng)機(jī)的骨干材料,在航空發(fā)動(dòng)機(jī)的高溫部件使用率超過 50% ,隨著航空發(fā)動(dòng)機(jī)第四代和第五代的研制,對(duì) GH4169 合金的使役性能也提出了更高的要求。 隨著冶煉工藝與成型制備技術(shù)的精進(jìn),GH4169 合金雖已基本滿足中國(guó)航空發(fā)動(dòng)機(jī)的需要,但與國(guó)外 Inconel718 合金相比還存在著不小的差距,主要表現(xiàn)在冶煉工藝不合理或技術(shù)參數(shù)不精準(zhǔn)造成的冶金黑斑以及合金組織均勻性較差造成的加工后的裂隙和淺坑[1]����。 這些由于技術(shù)不成熟造成的缺陷很有可能成為應(yīng)力集中的薄弱環(huán)節(jié),成為破裂和腐蝕的根源。 因此,找到合金組織表面的缺陷對(duì)于分析這些缺陷的成因以及提高合金冶煉工藝有著重要的意義����。 傳統(tǒng)的檢測(cè)都是由研究員使用掃描電鏡人工檢測(cè)組織表面存在的缺陷,這樣不僅效率低下,而且很容易由于視覺疲勞出現(xiàn)錯(cuò)檢漏檢的情況。 傳統(tǒng)的機(jī)器視覺檢測(cè)方法如 Canny 邊緣檢測(cè)[2]����、Prewitt 算子[3] 和小波變換[4]等通過手工設(shè)計(jì)提取特征,由于缺陷較小且有些缺陷顏色和背景相差不大造成魯棒性較差,檢測(cè)精度較低,無法滿足實(shí)用要求。

卷積神經(jīng)網(wǎng)絡(luò)在提取特征方面有非常強(qiáng)大的能力,相比較手工提取的特征,卷積神經(jīng)網(wǎng)絡(luò)提取的特征可以達(dá)到更好的效果[5]��。 因此,該文將 RetinaNet[6] 模型應(yīng)用于 GH4169 合金組織表面缺陷檢測(cè)上,并且針對(duì) RetinaNet 網(wǎng)絡(luò)對(duì)小目標(biāo)檢測(cè)不敏感的問題進(jìn)行改進(jìn),提出了一種 CA - RetinaNet 檢測(cè)算法�����。 首先, 在RetinaNet 網(wǎng)絡(luò)模型中引入了一種 CA-Resnet 結(jié)構(gòu)代替原來的殘差結(jié)構(gòu)[7],增強(qiáng)網(wǎng)絡(luò)提取特征的能力;之后重新構(gòu)建了特征金字塔網(wǎng)絡(luò)[8] 的底層結(jié)構(gòu),刪除了原來的 P7 有效特征層,重新構(gòu)建了 P2 有效特征層,提高了網(wǎng)絡(luò)模型對(duì)于小缺陷的檢測(cè)能力���。

1����、模型設(shè)計(jì)

RetinaNet 結(jié)構(gòu)上由特征提取網(wǎng)絡(luò)��、FPN( 特征金字塔網(wǎng)絡(luò))和兩個(gè) FCN 子網(wǎng)絡(luò)共同組成���。 ResNet 網(wǎng)絡(luò)負(fù)責(zé)提取圖像的特征,FPN 針對(duì)提取到的特征進(jìn)行多尺度語義融合以獲得表達(dá)力更強(qiáng)的特征圖,最后將這些特征圖輸入到兩個(gè) FCN 子網(wǎng)絡(luò)中,從而完成目標(biāo)框的分類和回歸任務(wù)�����。 由于 GH4169 合金組織表面缺陷形貌和一些偽缺陷接近并且大部分缺陷像素占比較少,因此使用傳統(tǒng) RetinaNet 檢測(cè)算法進(jìn)行檢測(cè)效果并不理想���。 該文提出的 CA-RetinaNet 網(wǎng)絡(luò)在 RetinaNet的基礎(chǔ)上,引用了 CA-Resnet 結(jié)構(gòu),并且重新構(gòu)建了FPN 層,從而提高了缺陷檢測(cè)的準(zhǔn)確率。

1.1����、 CA-Resnet 模塊

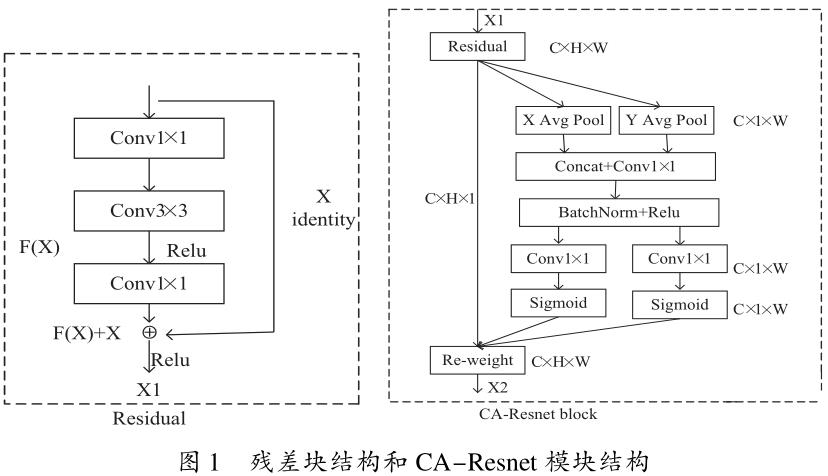

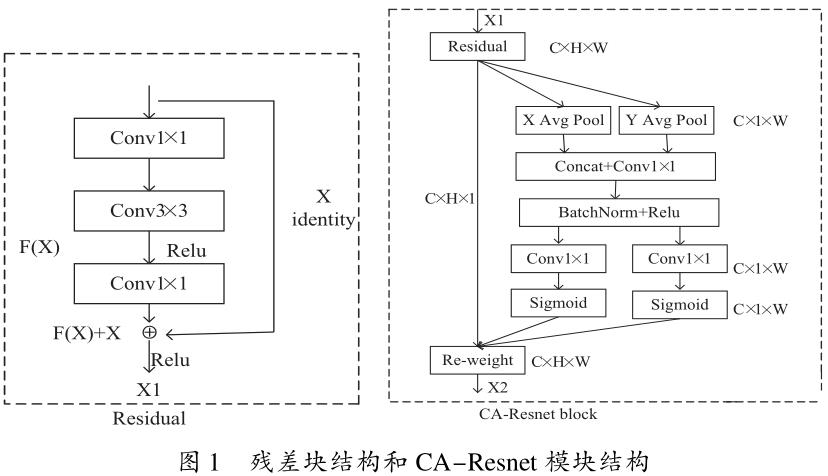

CA - Resnet模塊是由Resnet 模 塊 和 CA[9](Coordinate Attention)模塊兩部分構(gòu)成的,其主要結(jié)構(gòu)如圖 1 所示。

Resnet 模塊又被稱為殘差模塊,其主要思想是提出了一種 shortcut 的形式將前后層直接相連,使得后層網(wǎng)絡(luò)也可以得到前層網(wǎng)絡(luò)提取到的信息���。 這種方法可以更好地學(xué)習(xí)輸入與輸出之間的殘差 H(X) - X[7],使得神經(jīng)網(wǎng)絡(luò)可以更好的被訓(xùn)練,在一定程度上解決了網(wǎng)絡(luò)退化的問題���。 但在使用 Resnet50 對(duì)合金組織表面缺陷進(jìn)行特征提取時(shí)發(fā)現(xiàn),較小缺陷在經(jīng)過多次降采樣 后,特征逐漸消失。 為了解決這個(gè)問 題, 在Resnet50 中插入了CA模塊�����。

CA 模塊可以優(yōu)化神經(jīng)網(wǎng)絡(luò)學(xué)習(xí)到的參數(shù),在強(qiáng)調(diào)有用特征的同時(shí),抑制干擾性背景特征,以此來增加神經(jīng)網(wǎng)絡(luò)學(xué)習(xí)到的感興趣的目標(biāo)權(quán)重。 其主要結(jié)構(gòu)如圖 1 中 CA-Resnet 模塊所示�。CA模塊主要分為Coordinate 信 息 嵌 入 和Coordinate Attention 生成兩個(gè)步驟。 Coordinate 信息嵌入主要是為了注意力模塊可以捕捉到精確的遠(yuǎn)程空間交互信息����。 特征圖經(jīng)過特征提取網(wǎng)絡(luò)后得到大小C ×W × H 的 X1 特征圖,而后使用尺寸為( H ,1) 和(1, W )的平均池化函數(shù)分別沿水平方向和豎直方向?qū)γ總€(gè)通道進(jìn)行編碼輸出大小為 C ×1× W 的特征圖。Coordinate Attention 生成將以上的變換產(chǎn)生的兩個(gè)特征圖進(jìn)行 concatenate 操作,接著使用一個(gè)共享的 1×1的卷積進(jìn)行變換��、經(jīng) BN 操作和 Relu 非線性變換后生成大小 C / r ×1×( W + H )的張量和,然后利用兩個(gè)一維卷積變換將張量和變換為具有相同通道數(shù)的張量輸入到 Sigmoid 激活函數(shù)中,使用適當(dāng)?shù)目s減比來降低模型的復(fù)雜度,最后將學(xué)習(xí)到的權(quán)重與原始特征圖的每一個(gè)通道進(jìn)行相乘,得到注意力權(quán)重的 X2 特征圖�����。

這樣 CA 模塊不僅完成了通道權(quán)重的優(yōu)化,同時(shí)也捕捉到了水平方向和豎直方向上目標(biāo)的信息��。 比起 SE-Net[10](Squeeze-and-Excitation Networks) 只注重通道之間的關(guān)系,CA 模塊將位置信息與通道之間關(guān)系進(jìn)行了互補(bǔ),同時(shí)又避免了較大的計(jì)算開銷�。 該文在CA-RetinaNet 網(wǎng)絡(luò)中使用 CA-Resnet 模塊進(jìn)行特征提取,對(duì)圖像中的目標(biāo)進(jìn)行通道特征增強(qiáng),提高了神經(jīng)網(wǎng)絡(luò)提取特征的能力以及檢測(cè)精度。

1.2����、 重建特征金字塔網(wǎng)絡(luò)

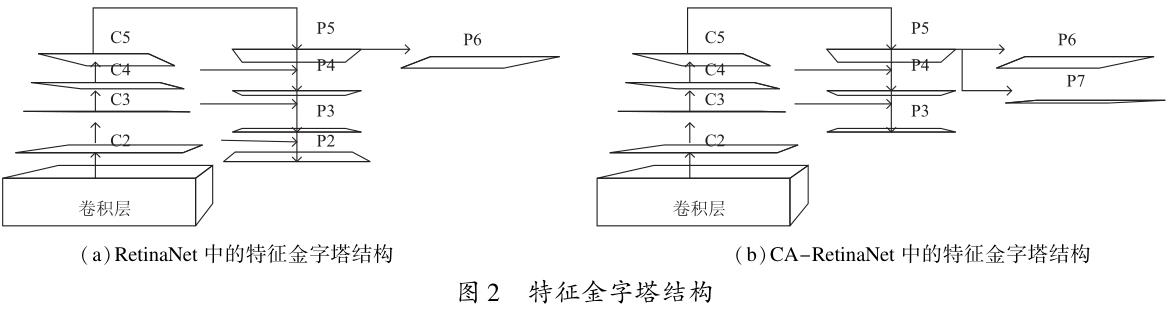

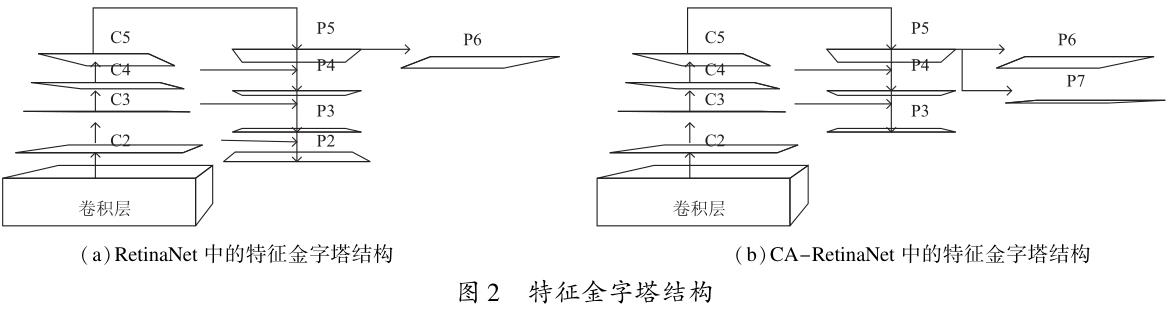

特征金字塔網(wǎng)絡(luò)是一種自頂向下且?guī)в袀?cè)向連接的網(wǎng)絡(luò),它可以融合低層網(wǎng)絡(luò)和深層網(wǎng)絡(luò)提取到的語義信息,實(shí)現(xiàn)多尺度預(yù)測(cè)。 在卷積網(wǎng)絡(luò)提取圖像的過程中,大的目標(biāo)特征點(diǎn)容易得到保留,小目標(biāo)特征點(diǎn)容易被跳過,特別是經(jīng)過很多層卷積和池化之后,小目標(biāo)的特征信息會(huì)越來越少,這對(duì)于小目標(biāo)檢測(cè)非常不利����。

而特征金字塔網(wǎng)絡(luò),在對(duì)特征點(diǎn)進(jìn)行下采樣后重新進(jìn)行上采樣,并且將下采樣與上采樣中長(zhǎng)寬相同的特征層進(jìn)行堆疊,這樣就可以保證小目標(biāo)的特征與信息不會(huì)完全丟失。

在 RetinaNet 網(wǎng)絡(luò)中,特征金字塔網(wǎng)絡(luò)由 P3 ~ P7五種尺度特征構(gòu)成[11],其中 P3(75,75)和 P4(38,38)用來檢測(cè)小目標(biāo),P5(19,19)����、P6(10,10)�、P7(5,5) 用來檢測(cè)大目標(biāo)�。 該文所使用的數(shù)據(jù)集大都是中小類型的缺陷,而 FPN 網(wǎng)絡(luò)所產(chǎn)生的 P7(5,5)有效特征層卻是用來檢測(cè)大目標(biāo)�。 因此,在 CA-Retinanet 中刪去 P7有效特征層,重新計(jì)算 CA-Resnet 所提取到的 C2 特征圖,將 P3 有效特征層進(jìn)行上采樣后與其融合得到一個(gè)新的有效特征層,該文將新建立起來的有效特征層成為 P2 有效特征層,用來檢測(cè)較小尺度的目標(biāo)。 具體如圖 2 所示�����。

另外,為了配合 P2 有效特征層的檢測(cè)尺度,將 anchor 的尺寸從(32,64,128,256,512) 調(diào)整為(16,32,64,128,256),以便網(wǎng)絡(luò)更加精準(zhǔn)地定位目標(biāo)�����。

1.3�、 Focal Loss 損失函數(shù)

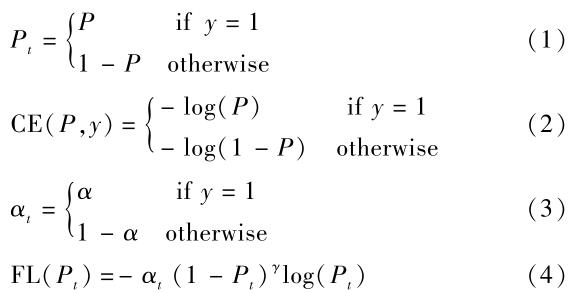

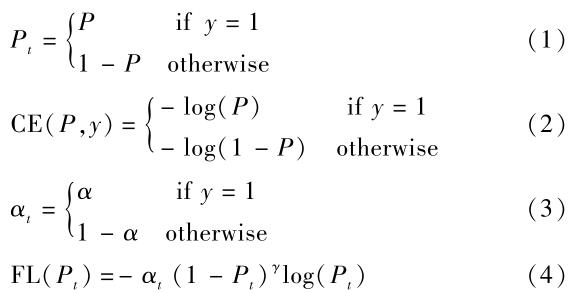

Focal Loss 損失函數(shù)由常用的交叉熵?fù)p失函數(shù)(CE)變形而來,是為了平衡正負(fù)樣本而提出來的一種新的 loss 計(jì)算方案,其具有兩個(gè)特點(diǎn):(1)控制正負(fù)樣本的權(quán)重。(2)控制容易分類和難分類樣本的權(quán)重���。

其公式如下:

其中, y 表示真實(shí)值, Pt 表示估計(jì)概率, P 表示概率,通過設(shè)置 琢 值(0-1 之間)控制正負(fù)樣本對(duì) loss 的貢獻(xiàn),通過控制 Pt 的值來控制權(quán)重的大小, Pt 越大則權(quán)重較大, Pt 越小相應(yīng)的權(quán)重也就越小,以此來抑制那些容易分類的樣本權(quán)重,提高難分類樣本的權(quán)重��。 有效地解決了正負(fù)樣本不平衡的問題�����。

2�����、 實(shí)驗(yàn)分析

2.1����、 數(shù)據(jù)集

2.1.1、 數(shù)據(jù)集介紹

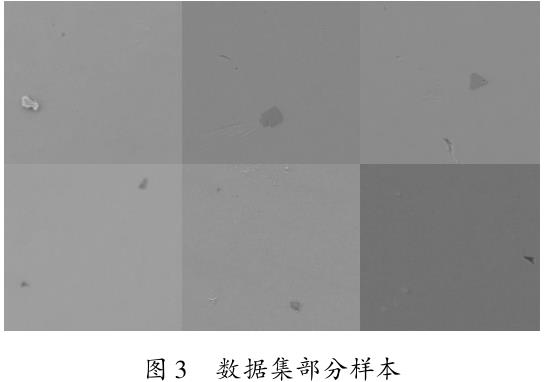

實(shí)驗(yàn)采用的 GH4169 合金來自于中航上大高溫合金材料有限公司,采用真空感應(yīng)-氣氛保護(hù)-真空自耗“三聯(lián)冶煉技術(shù)”及鍛造工藝生產(chǎn)的大棒材����。 從GH4169 合金鍛件大棒上截取樣品長(zhǎng)條,經(jīng)線切割、熱鑲�、磨樣、拋光后,使用配比為 20 ml 鹽酸+20 ml 無水乙醇+1.5 g 五水合硫酸銅的腐蝕溶液進(jìn)行化學(xué)腐蝕[12],再采用日本產(chǎn)尼康 LV100ND 金相顯微鏡進(jìn)行圖像數(shù)據(jù)采集,共獲取1882 張圖片����。 檢測(cè)的目標(biāo)分別是由于技術(shù)原料原因造成的缺陷(defect)、在磨樣過程 中 造 成 的 劃 痕 ( scratch ) 以 及 沾 上 的 附 著 物

(attachment)�����。 圖片分辨率大小為 512×512, 使 用LabelImg 軟件對(duì)圖像中的缺陷����、劃痕以及附著物進(jìn)行標(biāo)注,數(shù)據(jù)標(biāo)注格式為 PascalVOC 格式。 采集到的數(shù)據(jù)圖像如圖 3 所示�����。

2.1.2、 小目標(biāo)數(shù)據(jù)增強(qiáng)

小目標(biāo)檢測(cè)一直是目標(biāo)檢測(cè)領(lǐng)域中具有挑戰(zhàn)性的問題,特別是在缺陷檢測(cè)方面,小缺陷往往容易被忽略,這主要是因?yàn)樾∪毕菡急认袼剌^少且標(biāo)注面積占比較小,直接導(dǎo)致神經(jīng)網(wǎng)絡(luò)在訓(xùn)練的過程中會(huì)更加偏向于較大的物體����。 該文引用文獻(xiàn)[13] 的思想,采用oversampling(過采樣)的方法改進(jìn)離線數(shù)據(jù)增強(qiáng)方式。對(duì)于含有小缺陷的樣本進(jìn)行 2 次復(fù)制并且修改名字,

相當(dāng)于對(duì)小缺陷樣本進(jìn)行三倍的過采樣,從而引起神經(jīng)網(wǎng)絡(luò)的“注意”,提升小缺陷檢測(cè)的準(zhǔn)確率��。 該文使用的數(shù)據(jù)集中原始數(shù)據(jù)共 1 882 張圖片,采用過采樣離線數(shù)據(jù)增強(qiáng)方式進(jìn)行小缺陷數(shù)據(jù)增強(qiáng)后共 3 482 張圖片,按照 8:2 的比例隨機(jī)劃分訓(xùn)練集和驗(yàn)證集���。

2.2、 實(shí)驗(yàn)設(shè)置

2.2.1�、 實(shí)驗(yàn)環(huán)境

實(shí)驗(yàn)環(huán)境在 windows10 操作系統(tǒng)下,采用 pytorch的深度學(xué)習(xí)框架,并使用 NVIDIA GeForce RTX2080S(8G)進(jìn)行訓(xùn)練加速。

2.2.2����、 實(shí)驗(yàn)細(xì)節(jié)

網(wǎng)絡(luò)采用凍結(jié)訓(xùn)練方式進(jìn)行訓(xùn)練,凍結(jié)次數(shù)設(shè)置為 50。 訓(xùn)練時(shí)采用 Adam 優(yōu)化器進(jìn)行迭代優(yōu)化,未解凍部分訓(xùn)練輸入批次 batch_size = 8,學(xué)習(xí)率 learning_rate= 0.000 1,解凍部分訓(xùn)練 batch_size = 4,學(xué)習(xí)率learning_rate= 0.000 01�����。 采用遷移學(xué)習(xí)訓(xùn)練方式,導(dǎo)入 ResNet 網(wǎng)絡(luò)預(yù)訓(xùn)練模型,共計(jì)訓(xùn)練 150 個(gè)輪次���。

2.2.3�����、 評(píng)價(jià)指標(biāo)

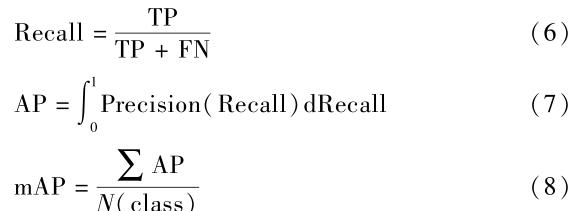

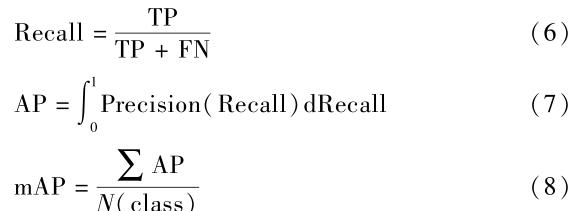

為了評(píng)估模型檢測(cè)的效果,采取 mAP(平均精度)對(duì)檢測(cè)結(jié)果進(jìn)行評(píng)價(jià)����。

其中,TP 是分類器認(rèn)為是正樣本且確實(shí)時(shí)正樣本的例子,FP 是分類器認(rèn)為是正樣本但實(shí)際上不是正樣本的例子,FN 是分類器認(rèn)為是負(fù)樣本但實(shí)際上不是負(fù)樣本的例子。 AP 是利用不同的 Precision 和 Recall 的組合計(jì)算得到的平均精度,mAP 就是所有類的 AP 值求平均�。

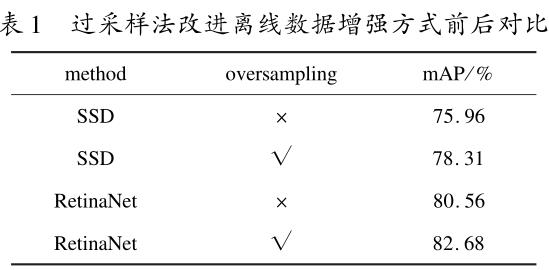

2.3、 過采樣法改進(jìn)離線數(shù)據(jù)增強(qiáng)實(shí)驗(yàn)

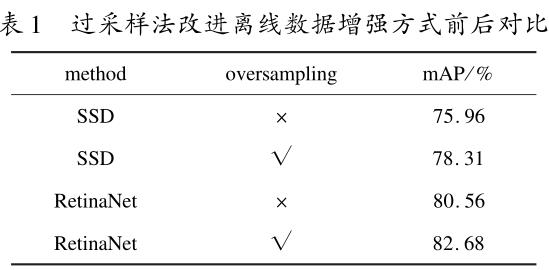

為了驗(yàn)證過采樣法改進(jìn)離線數(shù)據(jù)增強(qiáng)的有效性,分別在 SSD 模型上和 RetinaNet 模型上進(jìn)行了實(shí)驗(yàn)對(duì)比,實(shí)驗(yàn)結(jié)果如表 1 所示���。

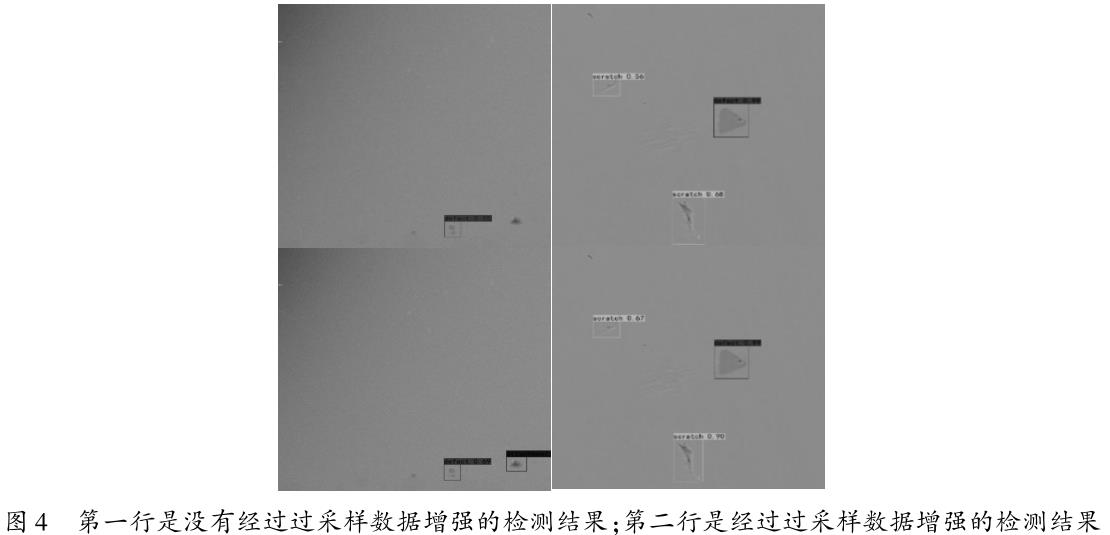

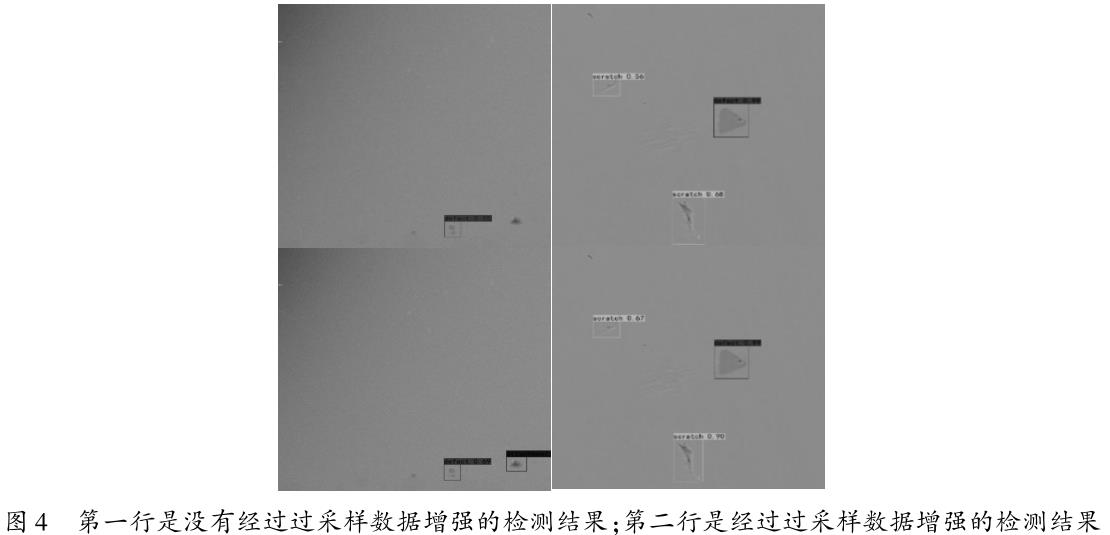

從實(shí)驗(yàn)對(duì)比結(jié)果可以看到,采用 oversampling 后的模型在三個(gè)種類的檢測(cè)精度上均有所提高,不僅如此,采用 oversampling 后的模型在檢測(cè)結(jié)果的標(biāo)注上也更加的準(zhǔn)確�。 以 RetinaNet 的檢測(cè)結(jié)果為例,使用oversampling 方法的 RetinaNet 模型能夠檢測(cè)出圖像中更多的目標(biāo)且置信度更高���。 根據(jù)圖 4 中第一列檢測(cè)結(jié)果對(duì)比圖 可 以 看 到, 沒 有 使 用 oversampling 方 法 的RetinaNet 模 型 只 檢 測(cè) 出 來 1 個(gè) 目 標(biāo), 而 使 用oversampling 方法的 RetinaNet 模型可以檢測(cè)出來 2 個(gè)目標(biāo);根據(jù)圖 4 中第二列檢測(cè)結(jié)果對(duì)比可以看到,經(jīng)過oversampling 方法后檢測(cè)的置信度分別為( scratch1:0. 67, defect: 0.99, scratch2: 0.90 ), 而 沒 有 經(jīng) 過oversampling 方 法 檢 測(cè) 的 置 信 度 分 別 為 ( scratch1: 0. 56, defect: 0.99, scratch2: 0.68 ), 很 明 顯 經(jīng) 過oversampling 方法后的模型檢測(cè)目標(biāo)的置信度要更高一些��。

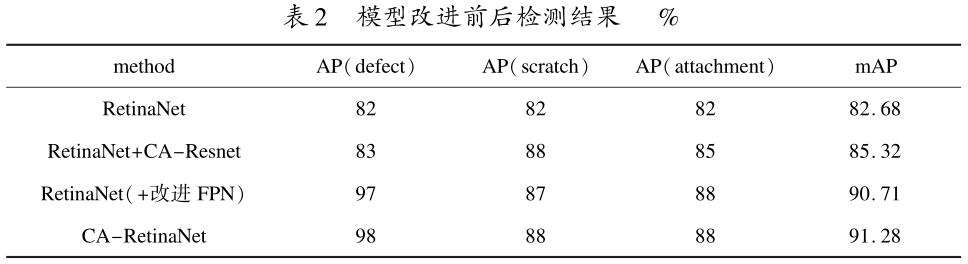

2.4�����、 模型改進(jìn)前后實(shí)驗(yàn)對(duì)比

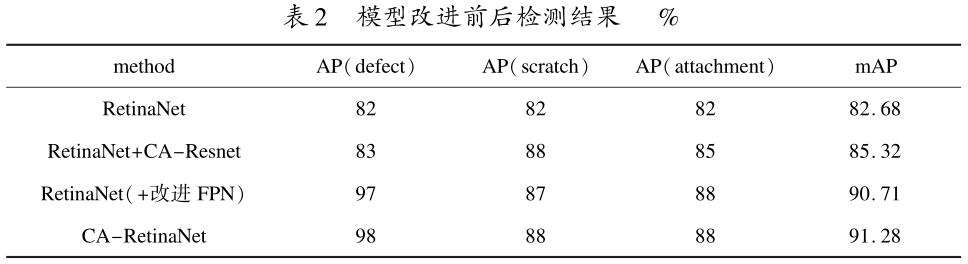

為了驗(yàn)證改進(jìn)的模型對(duì)于 GH4169 合金組織缺陷檢測(cè)的有效性,分別在 RetinaNet 模型,RetinaNet 加CA-Resnet,RetinaNet 加改進(jìn) FPN 以及 CA-RetinaNet上進(jìn)行實(shí)驗(yàn)��。 結(jié)果如表 2 所示�。 由表 2 可以看出,針對(duì) RetinaNet 做出的改進(jìn)是非常有效的,CA-RetinaNet相比較 RetinaNet 的 mAP 提升大約 8.6% ;在加入 CA-Resnet 后模型 mAP 提升大約 2.64% ;對(duì)比改進(jìn)前后特征金字塔網(wǎng)絡(luò)的檢測(cè)精度,可以看出 CA-RetinaNet 中的特征金字塔網(wǎng)絡(luò)有更好的特征提取能力,對(duì)比改進(jìn)前后的特征金字塔 網(wǎng)絡(luò)的檢測(cè)結(jié)果,可以看到重構(gòu)后的特征金字塔網(wǎng)絡(luò)擁有更好的特征提取能力,缺陷類AP 值大幅度提高��。

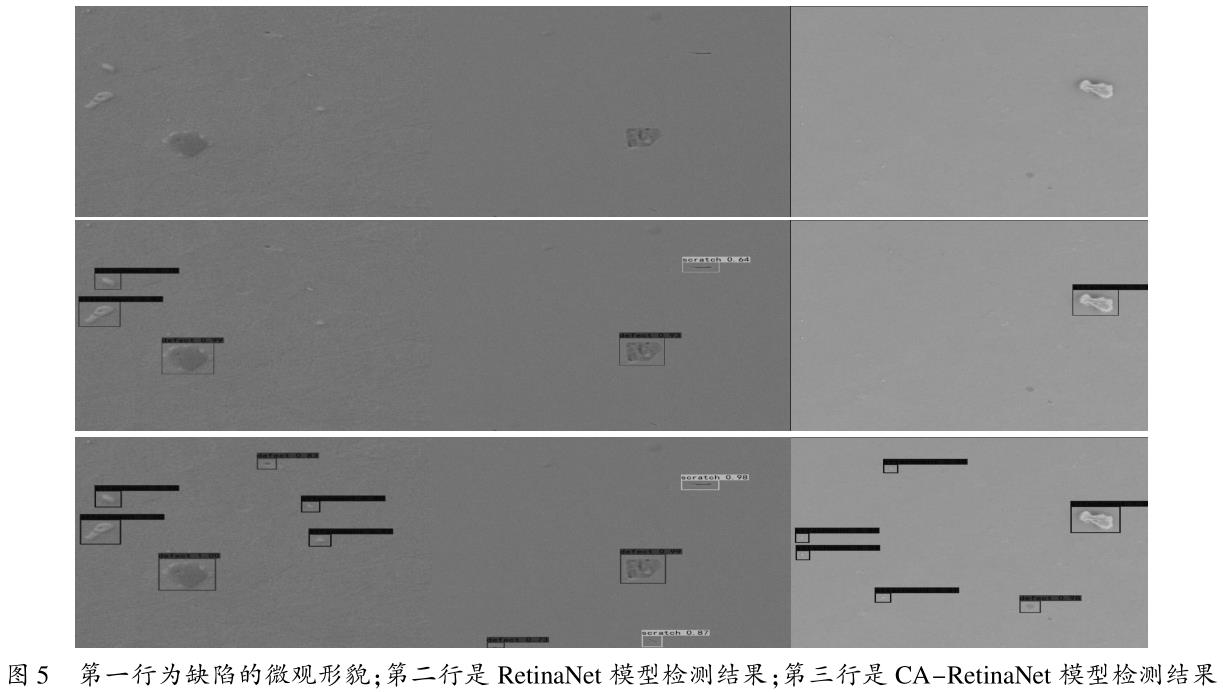

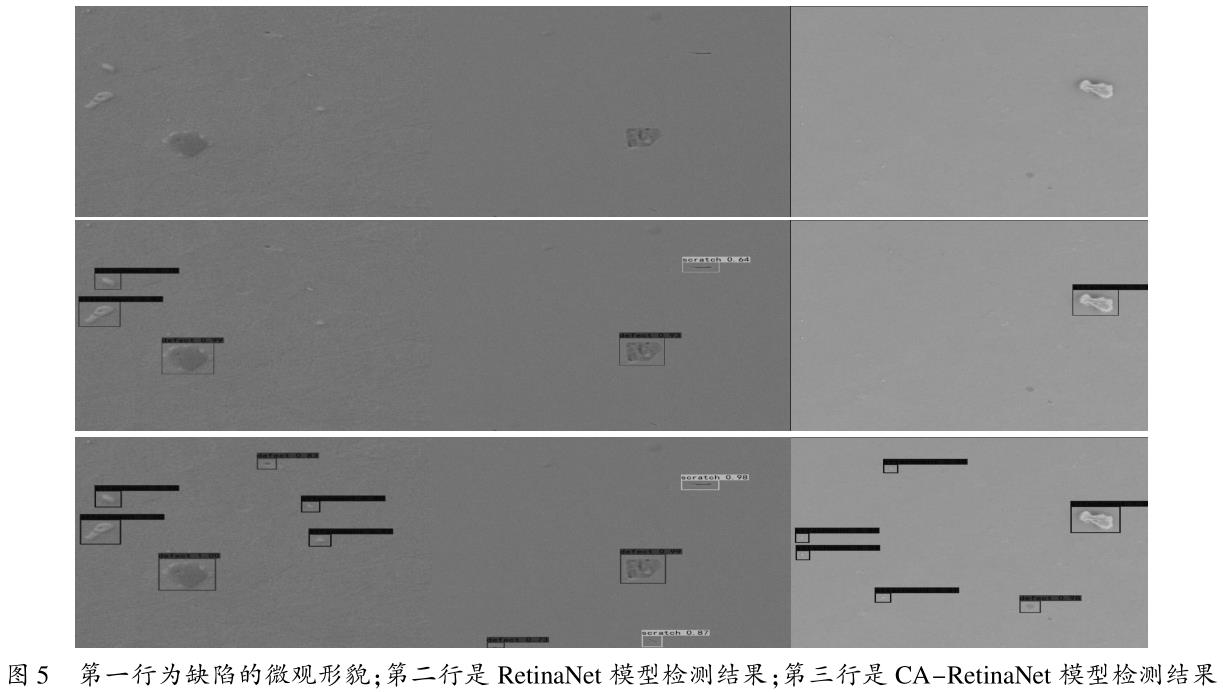

在 GH4169 合金組織表面缺陷數(shù)據(jù)集的測(cè)試集中選取 200 張圖片進(jìn)行檢測(cè)實(shí)驗(yàn),部分檢測(cè)結(jié)果如圖 5所示。 從圖中可以看出,原始 RetinaNet 模型僅僅可以檢測(cè)圖中少部分目標(biāo),而 CA-RetinaNet 幾乎可以檢測(cè)出圖中所有目標(biāo)�。

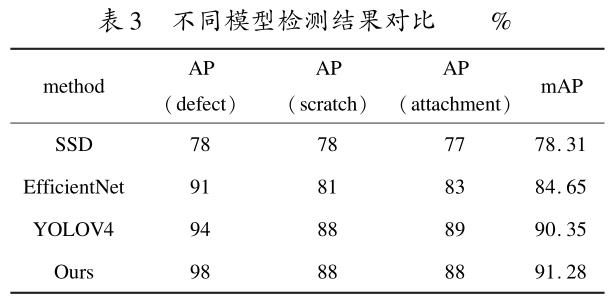

2.5、 不同目標(biāo)檢測(cè)模型對(duì)比

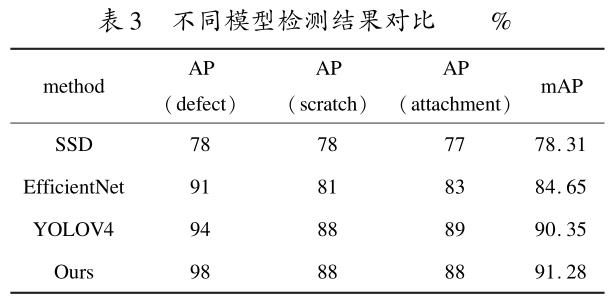

為了進(jìn)一步驗(yàn)證所提方法的有效性,在過采樣后的 GH4169 合 金 組 織 表 面 缺 陷 數(shù) 據(jù) 集 上, 將 CA -RetinaNet 算 法 與 當(dāng) 前 主 流 目 標(biāo) 檢 測(cè) 算 法 SSD[14]�、YOLO V4[15]及 EfficienNet[16]等算法進(jìn)行了對(duì)比,結(jié)果如表 3 所示。 由表 3 可知,CA-RetinaNet 檢測(cè)精度明顯高于當(dāng)前主流檢測(cè)方法 SSD 以及 EfficientNet;和YOLO V4 相比,檢測(cè)精度較高一些��。

3�、 結(jié)束語

針對(duì) GH169 合金組織表面缺陷較小,形貌不易區(qū)分造成傳統(tǒng)原始 RetinaNet 檢測(cè)算法錯(cuò)檢漏檢等問題,提出以下改進(jìn)方法:

(1)過采樣法改進(jìn)離線數(shù)據(jù)增強(qiáng)方式,對(duì)小缺陷樣本進(jìn)行 3 倍過采樣,不僅增加了目標(biāo)的檢測(cè)成功率,而且檢測(cè)出來的目標(biāo)置信度更高。

(2)提出一種 CA-RetinaNet 檢測(cè)算法,一方面將CA-Resnet 結(jié)構(gòu)引入到 RetinaNet 模型中,增強(qiáng)了網(wǎng)絡(luò)提取特征的能力,另一方面重新構(gòu)建了特征金字塔網(wǎng)絡(luò)的結(jié)構(gòu)�。 通過在 GH4169 合金組織表面缺陷數(shù)據(jù)集上進(jìn)行測(cè)試,CA-RetinaNet 算法相較于原始 RetinaNet檢測(cè)算法 mAP 提高了 8.6% ,與其他目標(biāo)檢測(cè)算法相比也有較大的優(yōu)勢(shì)。

參考文獻(xiàn):

[1]杜金輝,鄧群,曲敬龍,等.我國(guó)航空發(fā)動(dòng)機(jī)用 GH4169合金現(xiàn)狀與發(fā)展[C] //第八屆(2011) 中國(guó)鋼鐵年會(huì)論文集.北京:中國(guó)金屬學(xué)會(huì),2011:5.

[2] CANNY J.A computational approach to edge detection[J].IEEE Transactions on Pattern Analysis and Machine Intelli-gence,1986,PAMI-8(6):679-698.

[3]PREWITT J.Object enhancement and extraction[C] //Ob-ject enhancement and extraction picture processing and psy-chopictorics.New York:Academic,1970:15-19.

[4]FARGE M.Wavelet transform and their application to turbu-lence[J].Annu.Rev.Fluid Mech.,1992,24:395-457.

[5] 周曉彥,王 珂,李凌燕.基于深度學(xué)習(xí)的目標(biāo)檢測(cè)算法綜述[J].電子測(cè)量技術(shù),2017,40(11):89-93.

[6]LIN T Y, GOYAL P, GIRSHICK R, et al.Focal loss fordense object detection[J].IEEE Transactions on Pattern A-nalysis & Machine Intelligence,2020,42(2):318-327.

[7] HE K,ZHANG X,REN S,et al.Deep residual learning forimage recognition[ C] //Proceedings of 2016 IEEE confer-ence on computer vision pattern recognition ( CVPR).LasVegas:IEEE,2016:770-778.

[8]LIN T Y,DOLLAR P,GIRSHICK R,et al.Feature pyramidnetworks for object detection[C] //2017 IEEE conference oncomputer vision and pattern recognition (CVPR).Honolulu:IEEE,2017:936-944.

[9] HOU Q,ZHOU D,FENG J.Coordinate attention for efficientmobile network design[C] //2021 IEEE conference on com-puter vision and pattern recognition (CVPR).[s.l.]:IEEE,2021.

[10] JIE H,LI S,GANG S.Squeeze - and - excitation networks[C] //2018 IEEE/ CVF conference on computer vision andpattern recognition (CVPR).Salt Lake City:IEEE,2018.

[11] 邱呂,任德均,郜明,等.基于改進(jìn) RetinaNet 的醫(yī)用塑瓶裝箱計(jì)數(shù)算法[ J].計(jì)算機(jī)與現(xiàn)代化,2020 (12):99 -103.

[12] 蔣世川.GH4169 高溫合金熱變形行為及組織演變[J].鋼鐵釩鈦,2018,39(2):146-152.

[13] KISANTAL M,WOJNA Z,MURAWSKI J,et al.Augmenta-tion for small object detection[C] //9th international confer-ence on advances in computing and information technology.Rome:Institute of Research Engineers and Doctors,2019.

[14] LIU W,ANGUELOV D,ERHAN D,et al.SSD:single shotmultibox detector [ C] //European conference on computervision.[s.l.]:Springer,2016:21-37.

[15] BOCHKOVSKIY A,WANG C Y,LIAO H Y M.Yolov4:optimal speed and accuracy of object detection[ J].arXiv:2004.10934,2020.

[16] TAN M, LE Q.EfficientNet: rethinking model scaling forconvolutional neural networks[C] //Proceedings of the 2019international conference on machine learning.Long Beach:PMLR,2019:6105-6114.

相關(guān)鏈接